Google i Boston Dynamics integrują modele robotyczne Gemini ze Spotem w celu zaawansowanej percepcji i wykonywania zadań

Firma technologiczna Google ogłosiła partnerstwo z Boston Dynamics w celu zintegrowania swoich modeli rozumowania embodied Gemini Robotics z czworonożnym robotem Spot, co stanowi krok naprzód w zastosowaniu sztucznej inteligencji w rzeczywistej robotyce. Współpraca umożliwia robotowi lepszą interpretację otoczenia, identyfikację obiektów i wykonywanie zadań na podstawie instrukcji w języku naturalnym, zamiast polegać wyłącznie na wcześniej zaprogramowanych procedurach.

Integracja opiera się na pracy eksperymentalnej przeprowadzonej podczas wewnętrznego hackathonu w 2025 roku, podczas którego programiści badali, w jaki sposób duże modele językowe i systemy rozumowania wizualnego mogą zwiększyć autonomię Spota. Wykorzystując Gemini Robotics, robot może przetwarzać dane wizualne z kamer i przekładać instrukcje wysokiego poziomu — takie jak organizowanie obiektów w pomieszczeniu — na skoordynowane działania fizyczne.

W przeciwieństwie do tradycyjnego programowania robotyki, które często opiera się na sztywnej, krokowej logice, system wprowadza bardziej elastyczny interfejs oparty na monitach konwersacyjnych. Programiści stworzyli pośrednią warstwę oprogramowania wykorzystującą zestaw narzędzi programistycznych Spota, umożliwiając modelom Gemini komunikację z interfejsem programowania aplikacji robota. Ta struktura umożliwia AI wybór z określonego zestawu działań, w tym nawigacji, wykrywania obiektów, przechwytywania obrazu, chwytania i umieszczania.

Interfejsy języka naturalnego przekształcają wykonywanie zadań robotycznych

W praktycznych demonstracjach system wykazał zdolność do interpretowania ogólnych instrukcji i dostosowywania się do dynamicznych środowisk. Na przykład, gdy został poproszony o organizowanie przedmiotów, model AI analizował dane wizualne, identyfikował odpowiednie obiekty i kierował robotem przez sekwencję działań. Informacje zwrotne z robota — takie jak ukończenie zadania lub ograniczenia fizyczne — były włączane w czasie rzeczywistym, umożliwiając systemowi dostosowanie jego zachowania bez ręcznej interwencji.

Podejście zachowuje granice operacyjne poprzez ograniczenie AI do wcześniej zdefiniowanych możliwości w interfejsie API robota, zapewniając przewidywalną i kontrolowaną wydajność. Ten projekt równoważy adaptowalność z bezpieczeństwem, co jest kluczowym aspektem wdrażania AI w systemach fizycznych.

Partnerstwo podkreśla również potencjalne zyski w efektywności dla programistów. Zmniejszając potrzebę rozległego ręcznego kodowania, interfejsy języka naturalnego pozwalają inżynierom skupić się na definiowaniu celów, a nie na programowaniu każdej sekwencji działań. Ta zmiana może przyspieszyć rozwój aplikacji robotycznych w różnych branżach, takich jak produkcja, inspekcja i logistyka.

Chociaż implementacja pozostaje eksperymentalna, demonstracja odzwierciedla szersze trendy w fizycznej AI, gdzie modele fundamentalne są coraz częściej wykorzystywane do poprawy percepcji maszyn i podejmowania decyzji. Obie firmy wskazały, że trwają dalsze prace rozwojowe, w tym ciągła integracja systemów opartych na Gemini z platformami robotycznymi.

Współpraca sugeruje przejście w kierunku bardziej intuitivnej interakcji człowiek-maszyna, gdzie złożone zachowanie robotyczne może być kierowane za pomocą uproszczonych danych wejściowych. Wraz z ewolucją modeli AI takie integracje mogą rozszerzyć zakres funkcjonalny systemów autonomicznych, jednocześnie zmniejszając bariery techniczne ich wdrożenia.

Artykuł Google i Boston Dynamics integrują modele Gemini Robotics ze Spotem w celu zaawansowanej percepcji i wykonywania zadań ukazał się najpierw w Metaverse Post.

Możesz także polubić

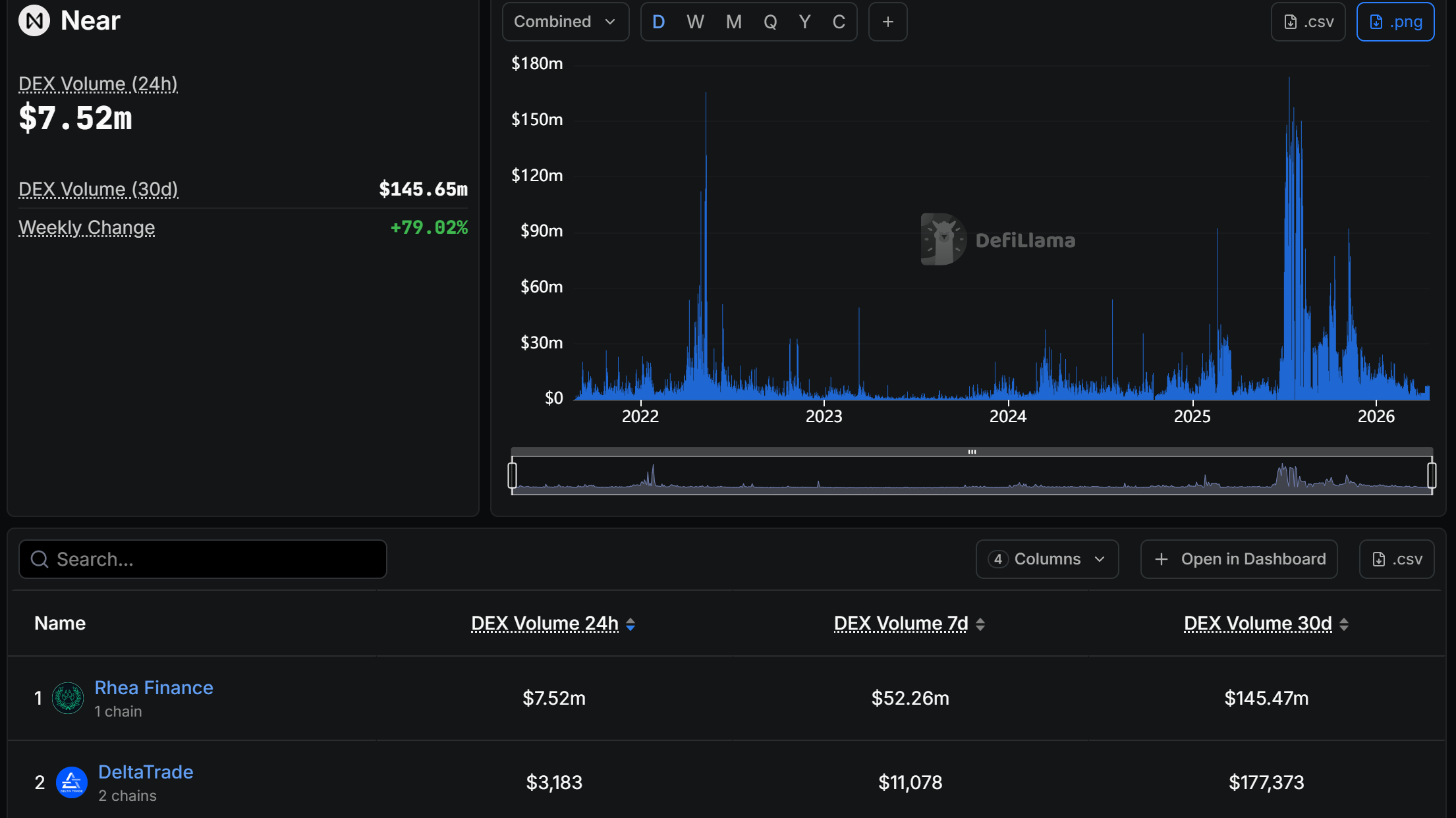

Hub DeFi Rhea Finance na NEAR Protocol traci 7,6 mln USD w wyniku ataku na oracle

Raport MIT wzywa do przejścia na ciągłe modele zgody na dane dla zaufania do AI