PANews 于3月21日报道,Tether 宣布在 QVAC Fabric 中发布跨平台 BitNet LoRA 微调框架,实现训练优化PANews 于3月21日报道,Tether 宣布在 QVAC Fabric 中发布跨平台 BitNet LoRA 微调框架,实现训练优化

如需对本内容提供反馈或相关疑问,请通过邮箱 [email protected] 联系我们。

PANews 于3月21日报道,Tether 宣布在 QVAC Fabric 中发布跨平台 BitNet LoRA 微调框架,支持对 Microsoft BitNet(1-bit LLM)的训练和推理进行优化。该框架显著降低了算力和内存需求,使得十亿参数模型能够在笔记本电脑、消费级 GPU 和智能手机上进行训练和微调。

该解决方案首次实现了在移动 GPU(包括 Adreno、Mali 和 Apple Bionic)上对 BitNet 模型进行微调。测试显示,1.25亿参数模型可在约10分钟内完成微调,10亿参数模型约需1小时,甚至可扩展至移动设备上的130亿参数模型。

此外,该框架支持 Intel、AMD 和 Apple Silicon 等异构硬件,并首次在非 NVIDIA 设备上实现 1-bit LLM LoRA 微调。在性能方面,BitNet 模型在移动 GPU 上的推理速度比 CPU 快2至11倍,同时与传统16位模型相比,内存使用量最多可减少约77.8%。

Tether 表示,这项技术有望打破对高端算力和云基础设施的依赖,推动 AI 训练向去中心化和本地化发展,并为联邦学习等新应用场景奠定基础。

免责声明: 本网站转载的文章均来源于公开平台,仅供参考。这些文章不代表 MEXC 的观点或意见。所有版权归原作者所有。如果您认为任何转载文章侵犯了第三方权利,请联系 [email protected] 以便将其删除。MEXC 不对转载文章的及时性、准确性或完整性作出任何陈述或保证,并且不对基于此类内容所采取的任何行动或决定承担责任。转载材料仅供参考,不构成任何商业、金融、法律和/或税务决策的建议、认可或依据。

您可能也会喜欢

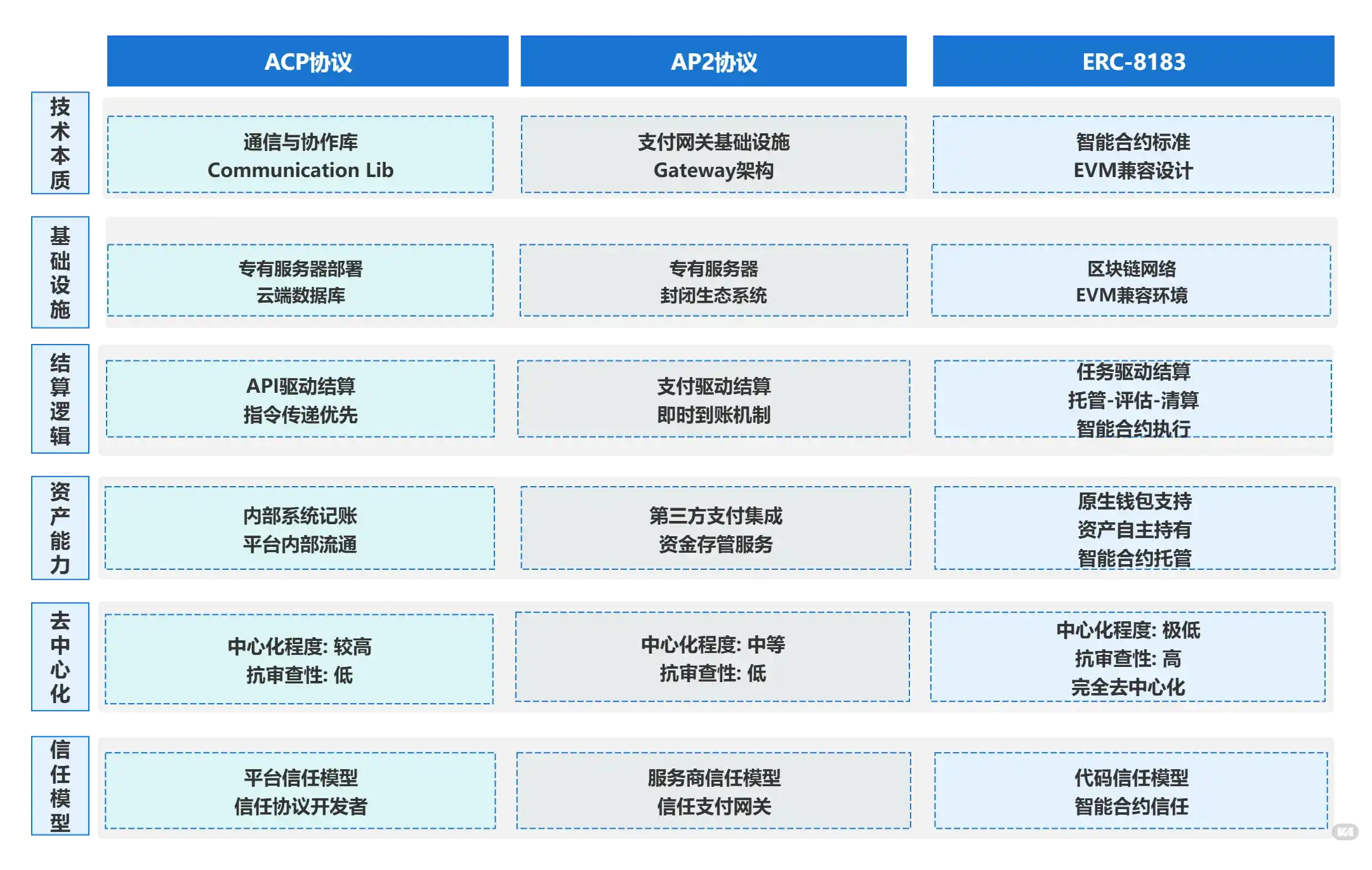

万亿 Agent 经济的底层商业协议:读懂 ERC-8183,不仅是支付,更是未来

一、技术背景与问题定义 1.1 AI智能体经济的崛起 随着AI技术与应用的快速演进,AI智能体正在从单纯的工具转变为创造价值、提供服务的经济参与者。 一个能生成专业级图像的智能体是…

分享

BlockWeek2026/03/21 23:33

下一个狗狗币埃隆·马斯克:Pepeto 提供长期实用性和巨大上涨潜力

加密货币市场正进入一个阶段,在这个阶段中,长期性和爆炸性回报不再相互排斥。根据CoinDesk报道,随着Bitcoin的流通

分享

Techbullion2026/03/21 22:41

从腾讯和 Circle:看投资的简单题和困难题

作者:Alex Xu AI 叙事继续发酵,相关个股的近期表现却有的身在盛夏,有的如在寒冬。 前者的代表是 Circle,第一大合规稳定币 USDC 的发行商,后者的代表是腾讯。…

分享

BlockWeek2026/03/21 22:32